[irp posts=“169795″ ]

Spricht man mit Fachleuten über das Thema Künstliche Intelligenz, fallen schnell Begriffe wie „Machine Learning“, „Deep Learning“, „Training“ und „Inferenz“. Allen ist gemein, dass für best- und schnellstmögliche Ergebnisse ein Rechnersystem zum Einsatz kommen sollte, in dem ein passender Computerchip steckt. Welche Komponenten hierfür infrage kommen und worin sie sich unterscheiden, steht in diesem Beitrag.

CPU vs. GPU vs. FGPA: Diese Computerchips gibt es

Grundsätzlich lassen sich KI-nahe Prozessoren in drei Gruppen unterteilen: CPU (Central Processing Unit), GPU (Graphics Processing Unit) und FGPA (Field Programmable Gate Array). Alle drei Prozessortypen führen KI-relevante Algorithmen aus, und das in allen drei Fällen ein wenig anders.

So stellt die CPU, wie der skalierbare Intel Xeon Prozessor (also der Hauptprozessor), den Generalisten unter den drei Chiptypen dar. Damit ist die große Mehrheit an KI-Anwendungen direkt lauffähig auf den zugehörigen Maschinen. Darüber hinaus lässt sich die zugrunde liegende Architektur an die KI-Software mit ein wenig Handarbeit anpassen.

[irp posts=“168611″ ]

Im Gegensatz dazu stellen FGPAs eine Art Misch-CPU dar. Sie verfügen über eine feste Rechenlogik, lassen sich aber aufgrund ihrer Programmierfähigkeit an das jeweilige Szenario und System bestmöglich anpassen. So eröffnen sich mit Intel FGPAs ganz neue Wege und Möglichkeiten, was das individuelle Justieren der KI-Systeme an die jeweiligen Applikationen betrifft.

Der dritte Typ von Computerchips, die GPU, spielt ebenfalls eine Rolle im KI-Universum, ist allerdings im Gegensatz zu ihren CPU- und FGPA-Pendants weniger generalistisch und weniger individuell einsetzbar.

Skalierbarer Intel Xeon Prozessor: Das macht die Intel-CPU in Sachen KI stark

Klar, die am Markt verfügbaren x86-Prozessoren sind allesamt leistungsstark und kommen in zahlreichen KI-Projekten zum Einsatz. Doch worin unterscheiden sich die skalierbaren Intel Xeon Prozessoren in diesem Kontext von anderen Highend-CPUs? Nun, speziell die integrierten KI-Beschleuniger auf Software-Basis sorgen dafür, dass die Intel-Prozessoren leistungsfähiger als ihre Pendants von AMD und Co. sind.

[irp posts=“168685″ ]

Ein Beispiel hierfür nennt sich Intel Deep Learning Boost. Das führt in Kombination mit optimierten Software-Applikationen zu KI/ML-Workloads, die im Vergleich zu AMD EPYC-basierten Anwendungen um den Faktor 1.5 schneller ausgeführt werden (siehe Referenz #43).

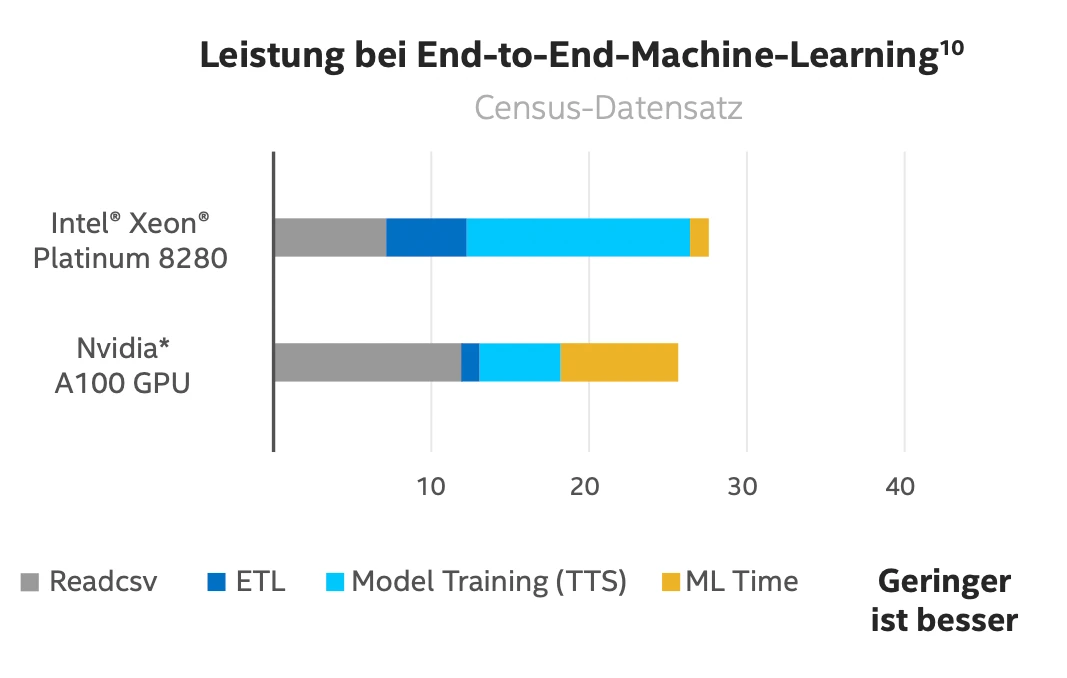

Aber auch die komplette Software-Strecke, vom Auslesen der KI-Daten bis zu den Vorhersagen anhand des passenden KI-Modells, profitiert von den skalierbaren Intel Xeon Prozessoren der 3. Generation. So ist zwar der Intel Xeon Platinum 8280 Prozessor knapp 2 Sekunden langsamer als eine Nvidia A100 GPU, dafür lässt sich das Intel-System in weiteren Bereichen einsetzen, was diese Rechner deutlich flexibler nutzbar macht.

[irp posts=“32039″ name=“Was der Turing-Test noch heute mit der Künstlichen Intelligenz zu tun hat“]

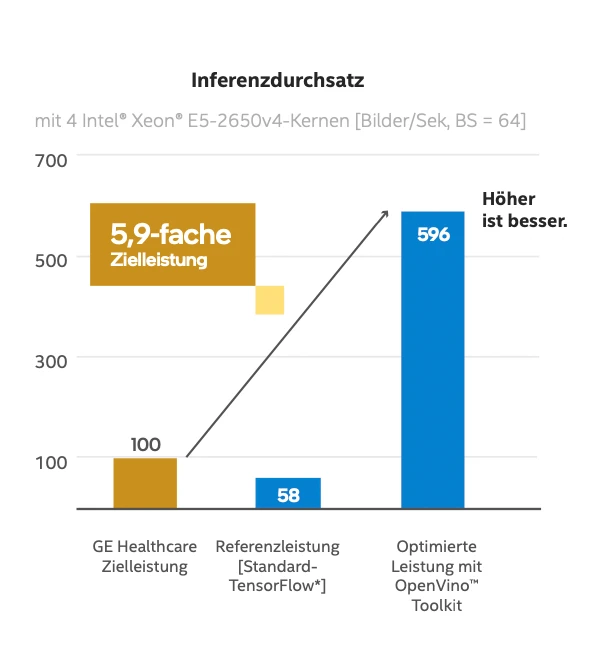

Dazu zählt beispielsweise das Ausführen von Inferenzaufgaben am Ende einer KI-Prozesskette. Hier kommen Systeme mit Intel Xeon Prozessoren, auf denen Intel OpenVino genutzt wird, auf eine 14-fache Leistung im Gegensatz zu Systemen, auf denen eine nicht-optimierte Version von TensorFlow genutzt wird.

Das leisten Intel Movidius VPUs im KI-Kontext

Mit den Intel Movidius VPUs (Vision Processing Unit) hat der Chiphersteller einen ganz speziellen KI-Beschleuniger im Portfolio. Denn diese Spezialchips kommen überall dort zum Einsatz, wo maschinelles Sehen und damit in Verbindung stehende KI-Aufgaben im Vordergrund stehen.

Dies ist beispielsweise in Fabriken der Fall, wo Spezialkameras die Fertigungsqualität im Auge behalten. Damit kommen diese Komponenten vor allem in Edge-Infrastrukturen zum Einsatz, wo eine ausgewogene Mischung aus Energieeffizienz und Rechenleistung wichtig ist. Zudem sind die Intel Movidius VPUs mit einer Reihe von am Markt befindlichen Sensoren kompatibel.

[irp posts=“158597″ name=“Darum setzen Unternehmen wie Microsoft und Accenture KI-Technik von Intel ein“]

Intel Arc: Gaming-Maschinen der Extraklasse mittels KI

Noch in diesem Quartal will Intel eine Art Gegenentwurf zu den bekannten GPUs von Nvidia & Co. auf den Markt bringen. Die Intel-Lösung nennt sich Intel Arc und soll allen Highend-Gamern ein ganz neues Spieleerlebnis ermöglichen. Zu der zugrunde liegenden GPU-Technologie gehört eine KI-gestützte Beschleunigererweiterung namens XeSS (Xe Super Sampling), die von den XMX (Xe Matrix eXtensions) der Xe-Prozessorkerne profitieren.

Hierbei kommen Machine Learning-Algorithmen zum Einsatz, die dank ihrer Intelligenz niedrig aufgelöste Bilder in hoher Auflösung darstellen zu können. Damit sollen 3D-Sequenzen möglich sein, die trotz der Vervierfachung der Auflösung von 1080p auf 4K doppelt so schnell dargestellt werden können.

[irp posts=“158337″ name=“Darum sind Intel und die Künstliche Intelligenz (KI) ein gutes Team“]

Disclaimer: Für das Verfassen und Veröffentlichen dieses Blogbeitrags hat mich die Firma Intel beauftragt. Bei der Ausgestaltung der Inhalte hatte ich nahezu freie Hand.