Am 10. Januar 2023 war es soweit: Da stellte Intel die nächste Intel CPU- und GPU-Generation einer breiten Öffentlichkeit vor, und das unter den Bezeichnungen Skalierbarer Intel Xeon Prozessor der 4. Generation, Intel Xeon CPU Max und Intel Data Center GPU Max. Diese Komponenten sollen ergänzend zur dritten Generation des skalierbaren Intel Xeon Prozessors im SuperMUC-NG am LRZ Garching zum Einsatz kommen. Für noch schnellere Simulationen und Berechnungen hochkomplexer Anwendungen und Workloads.

[irp posts=“168611″ ]

Der SuperMUC des Landesrechenzentrums Bayern beschäftigt mich und diesen Blog schon seit vielen Jahren. So durfte ich bereits 2014 mit Prof. Dr. Arndt Bode über den SuperMUC 2 sprechen.

Ziemlich genau 4 Jahre später war es dann sein Nachfolger, Prof. Dr. Dieter Kranzlmüller, der vor laufender Kamera eine Menge zu sagen hatte über die nächste Generation des LRZ-Supercomputers namens SuperMUC-NG.

Videochat: „Der SuperMUC-NG ist ein weiterer Meilenstein für das LRZ“

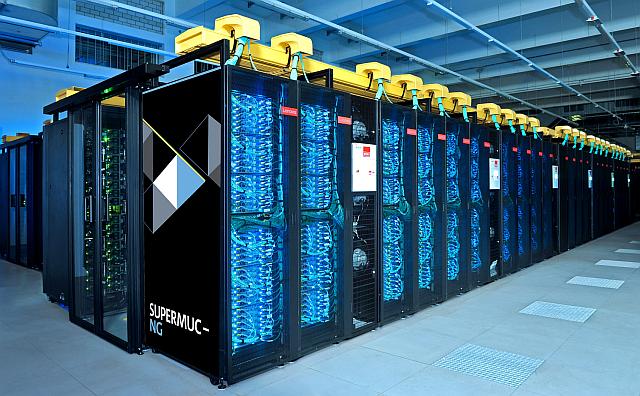

Und genau dieser SuperMUC-NG mit seinen über 300.000 Compute-Einheiten, die in Summe eine Rechenleistung von rund 27 PetaFLOPS leisten, soll in diesem Jahr um die nächste Generation der Intel CPU- und GPU-Reihe namens Intel Max Series erweitert werden. Doch welche Vorzüge und welche Beschleunigungen wird der Superrechner vor den Toren Münchens dadurch erfahren?

Phase 2 des SuperMUC-NG beginnt schon bald

Mit der offiziellen Vorstellung der nächsten CPU- und GPU-Generation kann auch die nächste Phase des SuperMUC-NG eingeläutet werden. Konkret bedeutet das eine Erweiterung des bestehenden Supercomputers um 240 Compute-Einheiten, die aus einer Kombination des Intel Xeon Prozessor Max und der Intel Data Center GPU Max bestehen. Das Ganze ist untergebracht in einem Lenovo-Rechner der ThinkSystem SD650-Familie. Weiterführende Infos zu diesem und weiteren Systemen auf Basis des skalierbaren Intel Xeon Prozessors der 4. Generation hat Lenovo bereits per Pressemeldung veröffentlicht.

Da für die geplanten Anwendungen sehr viel Speicherplatz erforderlich sein wird, soll im SuperMUC-NG der nächsten Generation ein Storage-System genutzt werden, das auf der DAOS-Architektur basiert (Distributed Asynchronous Object Storage). Hierfür kommt eine Speichereinheit zum Einsatz, in denen sich der skalierbare Intel Xeon Prozessor und der persistente Intel Optane-Speicher der 200-Reihe um das schnelle und latenzfreie Speichern großer Datenmengen kümmern.

[irp posts=“168685″ ]

Mit HemeLB lässt sich der SuperMUC-NG weiter ausreizen

Superkomplexe Anwendungen erfordern superschnelle Großrechner wie den SuperMUC-NG. So erforschen Mediziner und andere Experten mithilfe der Open Source-Anwendung HemeLB die Blutflusseigenschaften des menschlichen Körpers, um mehr zu erfahren über Herz-Kreislauf-Erkrankungen und wie sich diese künftig noch schneller erkennen und therapieren lassen.

Mit herkömmlichen Supercomputern ist eine Visualisierung des Blutkreislaufs lediglich in einer eher geringen Auflösung möglich, was unter Zuhilfenahme des Intel oneAPI Rendering Toolkit und Intel OSPRay Studio geschieht. Unter Verwendung der Intel Xeon Prozessoren Max lassen sich die zugehörigen Berechnungen alleine schon wegen der HBM-Speicheranbindung deutlich schneller ausführen.

Das Gute an dem MPI-Code der HemeLB-Anwendung, die in der Programmiersprache C++ entwickelt wurde, ist dessen enorme Skalierbarkeit. So zeigt das folgende Bild, dass jeder weitere Prozessor im SuperMUC-NG die Rechenleistung des zugrunde liegenden Systems linear beschleunigt. Damit lassen sich die medizinischen Anwendungen noch genauer und schneller nutzen.

Quelle: https://www.intel.de/content/www/de/de/customer-spotlight/stories/leibniz-supercomputing-centre-customer-story.html

Intel Data Center GPU Max verbessert 3D-Simulationen erheblich

Das Gleiche dürfte auch auf die 3D-Simulationen des Projektes zutreffen, auch hier wird die Intel Data Center GPU Max ihr volles Potential entfalten. Denn mit der enormen Grafikleistung der neuen Intel-GPU soll es künftig in Kombination mit dem SuperMUC-NG möglich sein, behandelnden Ärzten vor einer Operation eine hochaufgelöste Simulation der Blutgefäße des Patienten samt Blutfluss in 3D auf einen Monitor zu projizieren. Damit sollen sich Echtzeit-Untersuchungen durchführen lassen, und zwar ohne die Risiken für den zu operierenden Menschen, die bislang bestehen.

[irp posts=“161114″ ]

Disclaimer: Für das Verfassen und Veröffentlichen dieses Blogposts hat mich die Firma Intel beauftragt. Bei der Ausgestaltung der Inhalte hatte ich nahezu freie Hand.